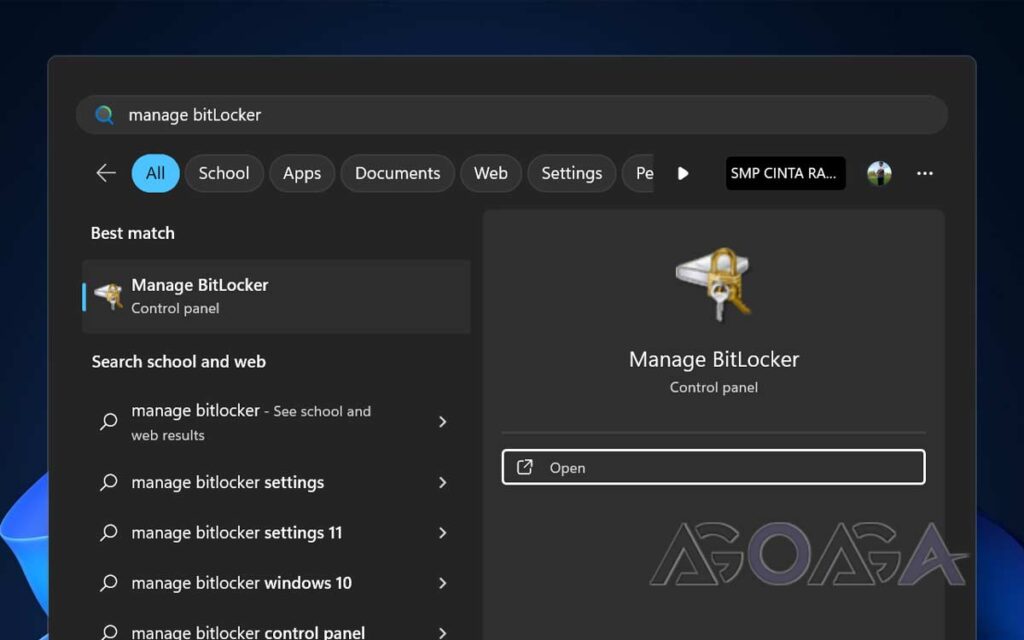

Kontrol dan penyesuaian masih sering dilakukan oleh Microsoft agar konten yang dihasilkan oleh Image Generator Copilot tidak melanggar pedoman Microsoft.

Nah, setelah sebelumnya memblokir beberapa perintah teks yang berujung pada karya seni kekerasan atau seksual, kini menurut laporan terbaru dari CNBC, pesan teks seperti “pro-pilihan”, “empat Dua Puluh” dan “pro-kehidupan” memberi peringatan saat mengetik “mungkin bertentangan dengan pedoman konten kami”.

Gambar yang didapat dari teknologi AI memang bisa dikatakan cukup bagus, namun banyak sekali Pencipta yang menggunakan teknologi ini untuk membuat konten yang menampilkan konten kekerasan dan seksual, sehingga tentunya harus dilakukan langkah tambahan untuk mencegah pembuatan konten tersebut.

Jadi, apakah pemblokiran kata benar-benar diperlukan?

Jawabannya tentu sangat dibutuhkan, karena seperti yang kita ketahui, teknologi AI saat ini mampu menipu banyak orang, terutama para orang tua yang baru mencoba teknologi tersebut.

Dengan akses yang tidak terbatas, kecerdasan buatan dapat menghasilkan banyak konten negatif baik berupa hoax, pornografi, bahkan konten kekerasan yang tentunya dapat merugikan tidak hanya satu pihak saja, melainkan banyak pihak lainnya.

Nah, jika kita mengingat kasus fotografer AI Taylor Swift beberapa minggu lalu, kasus ini bisa ditindaklanjuti karena banyak kasus serupa yang berasal dari teknologi AI ini.

Di masa depan, Microsoft, OpenAI, dan lainnya mungkin akan menerapkan keamanan ekstra pada konten yang mereka buat, karena pembatasan AI ini sebenarnya sangat diperlukan.

Bagaimana menurutmu? Komen dibawah ya kawan.

Sumber: CNBC